Das NUMA-Rätsel

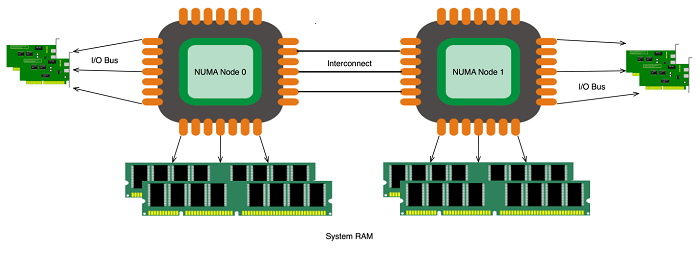

Bevor wir uns in die Feinheiten der Scheduler-Optimierung stürzen, lassen Sie uns die Bühne bereiten. Non-Uniform Memory Access (NUMA)-Architekturen sind in moderner Server-Hardware zur Norm geworden. Doch hier ist der Haken: Viele von uns entwickeln und betreiben unsere Go-Mikroservices immer noch so, als ob wir mit einheitlichem Speicherzugriff arbeiten würden. Es ist, als würde man versuchen, einen quadratischen Pflock in ein rundes Loch zu stecken – es könnte funktionieren, aber es ist alles andere als optimal.

Warum NUMA für Go-Mikroservices wichtig ist

Go's Laufzeitumgebung ist ziemlich schlau, aber nicht allwissend. Wenn es um NUMA-Bewusstsein geht, braucht es ein wenig Hilfe von uns Sterblichen. Hier ist, warum NUMA-Bewusstsein für Ihre Go-Mikroservices entscheidend ist:

- Die Speicherzugriffsverzögerung kann zwischen lokalen und entfernten NUMA-Knoten erheblich variieren

- Falsche Thread- und Speicherplatzierung kann zu Leistungseinbußen führen

- Die Leistung des Go-Garbage Collectors kann durch NUMA-Effekte beeinträchtigt werden

NUMA in Ihren Go-Mikroservices zu ignorieren, ist wie die Existenz von Verkehr zu ignorieren, wenn man eine Reise plant. Sicher, Sie könnten Ihr Ziel erreichen, aber die Reise wird alles andere als reibungslos verlaufen.

Der Completely Fair Scheduler (CFS)

Kommen wir nun zu unserem Hauptcharakter: dem Completely Fair Scheduler. Trotz seines Namens ist CFS nicht immer völlig fair, wenn es um NUMA-Systeme geht. Aber mit ein wenig Feinabstimmung können wir ihn für unsere Go-Mikroservices Wunder wirken lassen.

CFS: Das Gute, das Schlechte und das NUMA-Hässliche

CFS ist darauf ausgelegt, fair zu sein. Es versucht, jedem Prozess einen gleichen Anteil an CPU-Zeit zu geben. Aber in einer NUMA-Welt ist Fairness nicht immer das, was wir wollen. Manchmal müssen wir ein wenig unfair sein, um optimale Leistung zu erzielen. Hier ein kurzer Überblick:

- Das Gute: CFS bietet eine gute allgemeine Systemreaktionsfähigkeit und Fairness

- Das Schlechte: Es kann zu unnötigen Aufgabenmigrationen zwischen NUMA-Knoten führen

- Das NUMA-Hässliche: Ohne richtige Abstimmung kann es zu erhöhter Speicherzugriffsverzögerung für Go-Mikroservices führen

CFS für NUMA-bewusste Go-Mikroservices optimieren

Gut, Zeit, die Ärmel hochzukrempeln und sich mit etwas Scheduler-Optimierung die Hände schmutzig zu machen. Hier sind die Schlüsselbereiche, auf die wir uns konzentrieren werden:

1. Anpassung der Scheduling-Domains

Scheduling-Domains definieren, wie der Scheduler die Systemtopologie sieht. Durch Anpassung dieser können wir CFS NUMA-bewusster machen:

# Aktuelle Scheduling-Domains überprüfen

cat /proc/sys/kernel/sched_domain/cpu0/domain*/name

# Parameter der Scheduling-Domain anpassen

echo 1 > /proc/sys/kernel/sched_domain/cpu0/domain0/prefer_local_spreading

Dies teilt dem Scheduler mit, dass er Aufgaben nach Möglichkeit auf demselben NUMA-Knoten halten soll, um unnötige Migrationen zu reduzieren.

2. Feinabstimmung von sched_migration_cost_ns

Dieser Parameter steuert, wie eifrig der Scheduler Aufgaben zwischen CPUs migriert. Für NUMA-Systeme, die Go-Mikroservices ausführen, möchten wir diesen Wert oft erhöhen:

# Aktuellen Wert überprüfen

cat /proc/sys/kernel/sched_migration_cost_ns

# Wert erhöhen (z.B. auf 1000000 Nanosekunden)

echo 1000000 > /proc/sys/kernel/sched_migration_cost_ns

Diese Änderung macht den Scheduler weniger geneigt, Aufgaben zwischen NUMA-Knoten zu verschieben, wodurch die Wahrscheinlichkeit von entferntem Speicherzugriff verringert wird.

3. Nutzung von cgroups für NUMA-bewusste Ressourcenallokation

Control Groups (cgroups) können ein mächtiges Werkzeug sein, um NUMA-bewusste Ressourcenallokation durchzusetzen. Hier ist ein einfaches Beispiel, wie man cgroups verwendet, um einen Go-Mikroservice an einen bestimmten NUMA-Knoten zu binden:

# Eine cgroup für unseren Go-Mikroservice erstellen

mkdir /sys/fs/cgroup/cpuset/go_microservice

# CPUs und Speicherknoten zuweisen

echo "0-3" > /sys/fs/cgroup/cpuset/go_microservice/cpuset.cpus

echo "0" > /sys/fs/cgroup/cpuset/go_microservice/cpuset.mems

# Den Go-Mikroservice innerhalb dieser cgroup ausführen

cgexec -g cpuset:go_microservice ./my_go_microservice

Dies stellt sicher, dass unser Go-Mikroservice nur CPUs und Speicher von einem einzigen NUMA-Knoten verwendet, wodurch der Speicherzugriff über Knoten hinweg reduziert wird.

Die Go-Laufzeit: Ihr NUMA-bewusster Verbündeter

Während wir uns auf die Scheduler-Optimierung konzentrieren, sollten wir nicht vergessen, dass die Go-Laufzeit unser Verbündeter im Streben nach NUMA-Bewusstsein sein kann. Hier sind ein paar Go-spezifische Tipps:

1. GOGC und NUMA

Die GOGC-Umgebungsvariable steuert das Verhalten des Go-Garbage Collectors. In NUMA-Systemen möchten Sie diesen Wert möglicherweise anpassen, um die Häufigkeit globaler Sammlungen zu reduzieren:

export GOGC=200

Dies teilt der Go-Laufzeit mit, die Garbage Collection seltener auszulösen, was möglicherweise den Speicherzugriff über Knoten hinweg während der Sammlung reduziert.

2. Nutzung von runtime.NumCPU()

Beim Schreiben von Go-Code für NUMA-Systeme sollten Sie darauf achten, wie Sie Goroutinen verwenden. Hier ist ein einfaches Beispiel, wie man einen NUMA-bewussten Worker-Pool erstellt:

import "runtime"

func createNUMAAwareWorkerPool() {

numCPU := runtime.NumCPU()

for i := 0; i < numCPU; i++ {

go worker(i)

}

}

func worker(id int) {

runtime.LockOSThread()

// Worker-Logik hier

}

Durch die Verwendung von runtime.NumCPU() und runtime.LockOSThread() erstellen wir einen Worker-Pool, der eher die NUMA-Grenzen respektiert.

Die Auswirkungen messen

All diese Optimierungen sind großartig, aber wie wissen wir, ob sie tatsächlich einen Unterschied machen? Hier sind einige Werkzeuge und Metriken, auf die Sie achten sollten:

- numastat: Bietet NUMA-Speicherstatistiken

- perf: Kann verwendet werden, um Cache-Misses und Speicherzugriffsmuster zu messen

- Go's integriertes Profiling: Verwenden Sie

runtime/pprof, um Ihre Anwendung vor und nach der Optimierung zu profilieren

Hier ist ein kurzes Beispiel, wie man numastat verwendet, um die NUMA-Speichernutzung zu überprüfen:

numastat -p $(pgrep my_go_microservice)

Achten Sie auf Ungleichgewichte in der Speicherallokation über NUMA-Knoten hinweg. Wenn Sie viele "fremde" Speicherzugriffe sehen, könnte Ihre Optimierung eine Anpassung benötigen.

Fallstricke und Stolpersteine

Bevor Sie losziehen und anfangen, jedes System in Sichtweite zu optimieren, ein Wort der Vorsicht:

- Überoptimierung kann zu Ressourcenunterauslastung führen

- Was für einen Go-Mikroservice funktioniert, muss nicht für einen anderen funktionieren

- Scheduler-Optimierung kann in komplexer Weise mit dem Verhalten der Go-Laufzeit interagieren

Messen, testen und validieren Sie Ihre Änderungen immer in einer kontrollierten Umgebung, bevor Sie sie in die Produktion einführen. Denken Sie daran, mit großer Macht kommt große Verantwortung (und potenziell große Kopfschmerzen, wenn Sie nicht vorsichtig sind).

Zusammenfassung: Die Kunst des Gleichgewichts

Die Optimierung des Completely Fair Scheduler für NUMA-bewusste Go-Mikroservices ist wirklich eine Kunstform. Es geht darum, das richtige Gleichgewicht zwischen Fairness, Leistung und Ressourcennutzung zu finden. Hier sind die wichtigsten Erkenntnisse:

- Verstehen Sie Ihre Hardware: NUMA-Architektur ist wichtig

- Optimieren Sie CFS-Parameter mit NUMA im Hinterkopf

- Nutzen Sie cgroups für eine feinkörnige Kontrolle

- Arbeiten Sie mit der Go-Laufzeit, nicht gegen sie

- Messen und validieren Sie immer Ihre Optimierungsbemühungen

Denken Sie daran, das Ziel ist nicht, ein perfekt NUMA-bewusstes System zu schaffen (was praktisch unmöglich ist), sondern den Sweet Spot zu finden, an dem Ihre Go-Mikroservices innerhalb der Grenzen Ihrer NUMA-Architektur am besten funktionieren.

Also, das nächste Mal, wenn jemand sagt: "Es ist nur ein Scheduler, wie komplex könnte es sein?" können Sie wissend lächeln und sie auf diesen Artikel verweisen. Viel Spaß beim Optimieren, und mögen Ihre Go-Mikroservices reibungslos über NUMA-Knoten hinweg laufen!

"In der Welt der NUMA-bewussten Go-Mikroservices ist der Scheduler nicht nur ein Schiedsrichter – er ist der Choreograf eines komplexen Tanzes zwischen Code und Hardware."

Haben Sie Kriegsgeschichten über Scheduler-Optimierung für NUMA-Systeme? Oder vielleicht einige clevere Go-Tricks für NUMA-Bewusstsein? Hinterlassen Sie sie in den Kommentaren unten. Lassen Sie uns aus den Triumphen (und Katastrophen) der anderen lernen!