TL;DR: Rust + Async = Job Queue auf Steroiden

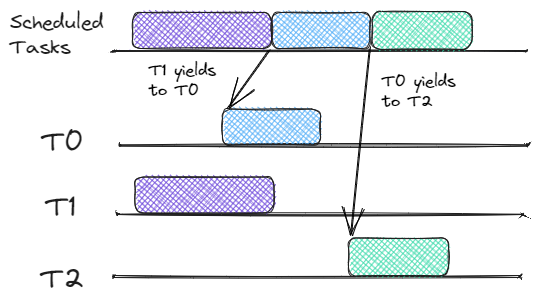

Rusts asynchrone Laufzeitumgebung ist wie ein Espresso mit Raketenantrieb für deine Job-Warteschlange. Sie ermöglicht die gleichzeitige Ausführung von Aufgaben ohne den Overhead von Betriebssystem-Threads, was sie perfekt für I/O-gebundene Operationen wie das Verwalten einer Job-Warteschlange macht. Lass uns eintauchen, wie wir dies nutzen können, um ein Backend zu erstellen, das deine Aufgaben schneller als ein koffeinierter Gepard abarbeiten lässt.

Die Bausteine: Tokio, Futures und Channels

Bevor wir mit dem Bau unserer leistungsstarken Job-Warteschlange beginnen, sollten wir uns mit den Hauptakteuren vertraut machen:

- Tokio: Das vielseitige asynchrone Laufzeitsystem für Rust

- Futures: Repräsentationen von asynchronen Berechnungen

- Channels: Kommunikationskanäle zwischen verschiedenen Teilen deines asynchronen Systems

Diese Komponenten arbeiten zusammen wie eine gut geölte Maschine und ermöglichen es uns, eine Job-Warteschlange zu bauen, die eine beeindruckende Durchsatzrate bewältigen kann, ohne ins Schwitzen zu geraten.

Die Job-Warteschlange entwerfen: Ein Überblick

Unsere Job-Warteschlange wird aus drei Hauptkomponenten bestehen:

- Job-Empfänger: Nimmt eingehende Jobs an und fügt sie der Warteschlange hinzu

- Job-Warteschlange: Speichert Jobs, die auf die Bearbeitung warten

- Job-Prozessor: Holt Jobs aus der Warteschlange und führt sie aus

Schauen wir uns an, wie wir dies mit Rusts asynchronen Funktionen umsetzen können.

Der Job-Empfänger: Der Türsteher deiner Warteschlange

Zuerst erstellen wir eine Struktur, um unsere Jobs darzustellen:

struct Job {

id: u64,

payload: String,

}

Nun implementieren wir den Job-Empfänger:

use tokio::sync::mpsc;

async fn job_receiver(mut rx: mpsc::Receiver, queue: Arc>>) {

while let Some(job) = rx.recv().await {

let mut queue = queue.lock().await;

queue.push_back(job);

println!("Job empfangen: {}", job.id);

}

}

Diese Funktion verwendet Tokios MPSC (Multi-Producer, Single-Consumer) Kanal, um Jobs zu empfangen und sie in eine gemeinsame Warteschlange zu schieben.

Die Job-Warteschlange: Wo Aufgaben warten

Unsere Job-Warteschlange ist ein einfacher VecDeque, der in einem Arc> für sicheren gleichzeitigen Zugriff verpackt ist:

use std::collections::VecDeque;

use std::sync::Arc;

use tokio::sync::Mutex;

let queue: Arc>> = Arc::new(Mutex::new(VecDeque::new()));

Der Job-Prozessor: Wo die Magie passiert

Nun zum Herzstück, unserem Job-Prozessor:

async fn job_processor(queue: Arc>>) {

loop {

let job = {

let mut queue = queue.lock().await;

queue.pop_front()

};

if let Some(job) = job {

println!("Job verarbeiten: {}", job.id);

// Simuliere einige asynchrone Arbeiten

tokio::time::sleep(Duration::from_millis(100)).await;

println!("Job abgeschlossen: {}", job.id);

} else {

// Keine Jobs, machen wir eine kurze Pause

tokio::time::sleep(Duration::from_millis(10)).await;

}

}

}

Dieser Prozessor läuft in einer Endlosschleife, überprüft auf Jobs und verarbeitet sie asynchron. Wenn keine Jobs vorhanden sind, macht er eine kurze Pause, um unnötiges Drehen zu vermeiden.

Alles zusammenfügen: Das Hauptereignis

Nun verbinden wir alles in unserer Hauptfunktion:

#[tokio::main]

async fn main() {

let (tx, rx) = mpsc::channel(100);

let queue = Arc::new(Mutex::new(VecDeque::new()));

// Den Job-Empfänger starten

let queue_clone = Arc::clone(&queue);

tokio::spawn(async move {

job_receiver(rx, queue_clone).await;

});

// Mehrere Job-Prozessoren starten

for _ in 0..4 {

let queue_clone = Arc::clone(&queue);

tokio::spawn(async move {

job_processor(queue_clone).await;

});

}

// Einige Jobs generieren

for i in 0..1000 {

let job = Job {

id: i,

payload: format!("Job {}", i),

};

tx.send(job).await.unwrap();

}

// Warten, bis alle Jobs verarbeitet sind

tokio::time::sleep(Duration::from_secs(10)).await;

}

Leistungssteigerer: Tipps und Tricks

Jetzt, da wir unsere Grundstruktur haben, schauen wir uns einige Möglichkeiten an, um noch mehr Leistung aus unserer Job-Warteschlange herauszuholen:

- Batching: Mehrere Jobs in einer einzigen asynchronen Aufgabe verarbeiten, um den Overhead zu reduzieren.

- Priorisierung: Eine Prioritätswarteschlange anstelle einer einfachen FIFO implementieren.

- Rückstau: Begrenzte Kanäle verwenden, um das System nicht zu überlasten.

- Metriken: Tracking implementieren, um Warteschlangengröße, Verarbeitungszeit und Durchsatz zu überwachen.

Potenzielle Fallstricke: Vorsicht!

Wie bei jedem Hochleistungssystem gibt es einige Dinge, auf die man achten sollte:

- Deadlocks: Vorsicht bei der Sperrreihenfolge, wenn mehrere Mutexe verwendet werden.

- Ressourcenerschöpfung: Sicherstellen, dass dein System die maximale Anzahl gleichzeitiger Aufgaben bewältigen kann.

- Fehlerbehandlung: Robuste Fehlerbehandlung implementieren, um zu verhindern, dass Aufgabenfehler das gesamte System zum Absturz bringen.

Fazit: Deine Warteschlange, aufgeladen

Durch die Nutzung von Rusts asynchroner Laufzeitumgebung haben wir ein Job-Warteschlangen-Backend erstellt, das eine massive Durchsatzrate mit minimalem Overhead bewältigen kann. Die Kombination aus Tokio, Futures und Channels ermöglicht es uns, Aufgaben gleichzeitig und effizient zu verarbeiten und dabei unsere Systemressourcen optimal zu nutzen.

Denke daran, dass dies nur ein Ausgangspunkt ist. Du kannst dieses System weiter optimieren und anpassen, um es an deine spezifischen Bedürfnisse anzupassen. Vielleicht fügst du Persistenz hinzu, implementierst Wiederholungen für fehlgeschlagene Jobs oder verteilst die Warteschlange auf mehrere Knoten. Die Möglichkeiten sind endlos!

"Mit großer Macht kommt große Verantwortung" - Onkel Ben (und jeder Rust-Programmierer jemals)

Also, nutze die Kraft von Rusts asynchroner Laufzeitumgebung und baue Job-Warteschlangen, die selbst die anspruchsvollsten Systeme zufriedenstellen. Dein zukünftiges Ich (und deine Nutzer) werden es dir danken!

Denkanstöße

Bevor du losstürmst, um dein gesamtes Backend in Rust neu zu schreiben, nimm dir einen Moment Zeit, um darüber nachzudenken:

- Wie würde dies im Vergleich zur Implementierung eines ähnlichen Systems in Go oder Node.js abschneiden?

- Welche Art von Arbeitslasten würde am meisten von dieser Architektur profitieren?

- Wie würdest du Persistenz und Fehlertoleranz in einer Produktionsumgebung handhaben?

Viel Spaß beim Programmieren, und mögen deine Warteschlangen immer schnell und deine Aufgaben immer abgeschlossen sein!